AI, algoritmes en persoonsgegevens: waarom je soms drie checks nodig hebt.

In veel organisaties zie ik, Anna Mischke (Privacy & Legal Consultant) hetzelfde gebeuren: teams werken aan een nieuw algoritme of AI toepassing, en ineens liggen er drie verschillende instrumenten op tafel. DPIA, IAMA en AIIA. De vraag die dan bijna altijd volgt: welke moeten we gebruiken, en wanneer?

Vanuit mijn rol als consultant merk ik dat dit een van de meest voorkomende knelpunten is. Het voelt alsof je drie gereedschappen in je handen hebt, zonder dat iemand je precies vertelt welke hamer waarvoor bedoeld is. Maar zodra je begrijpt wat elk instrument beoordeelt, ontstaat er rust en overzicht.

De kern is simpel: wat beoordeel je?

- Persoonsgegevens = DPIA (Data Protection Impact Assessment)

- Algoritmes = IAMA (Impact Assessment Mensenrechten en Algoritmes)

- AI-systemen = AIIA (AI Impact Assessment)

Maar in de praktijk is het natuurlijk nooit zo simpel als één regel. Daarom neem ik je mee in hoe ik dit in projecten aanpak en waar de instrumenten elkaar raken.

DPIA: wanneer je met persoonsgegevens werkt

In vrijwel elk project waar persoonsgegevens worden verwerkt, komt vroeg of laat de vraag: “Moeten we een DPIA doen?”

Een Data Protection Impact Assessment (DPIA) is verplicht zodra je een verwerking uitvoert die waarschijnlijk een hoog privacyrisico oplevert. Dat staat in de Algemene verordening gegevensbescherming (AVG) en wordt bevestigd door de Autoriteit Persoonsgegevens (AP). In mijn ervaring is een DPIA niet alleen een verplichting, maar ook een waardevol hulpmiddel om scherp te krijgen welke risico’s er zijn voor betrokkenen, en welke maatregelen je moet nemen om deze risico’s te beperken.

Mijn advies is om een DPIA uit te voeren wanneer:

- Je persoonsgegevens verwerkt;

- De verwerking nieuw, grootschalig of gevoelig is;

- Je wettelijke verplichtingen hebt vanuit de AVG (Algemene Verordening Gegevensbescherming), Wpg (Wet politiegegevens) of Wjsg (Wet justitiële en strafvorderlijke gegevens).

Een DPIA is daarmee hét instrument voor alles wat raakt aan privacy en gegevensbescherming.

IAMA: wanneer je algoritmes inzet

Het inzetten van algoritmes betekent het gebruiken van een set vaste, computergestuurde regels en stappen om een specifieke taak uit te voeren, een probleem op te lossen of een beslissing te nemen.

Waar de DPIA stopt, begint de IAMA vaak. Het Impact Assessment Mensenrechten en Algoritmes (IAMA) richt zich op mensenrechten in brede zin. Dit instrument is vooral waardevol zodra een algoritme invloed heeft op beslissingen die burgers raken.

Denk aan risico’s zoals discriminatie, ongelijke behandeling, gebrek aan uitlegbaarheid of verlies van autonomie. De IAMA helpt teams om deze risico’s niet alleen te identificeren, maar ook om erover in gesprek te gaan, iets wat in de praktijk minstens zo belangrijk is.

Mijn advies is om een IAMA te gebruiken wanneer:

- Je een algoritme inzet dat beslissingen ondersteunt of automatiseert;

- Je risico’s wilt beoordelen op het gebied van mensenrechten;

- Je transparantie en uitlegbaarheid wilt borgen van algoritmes.

In projecten merk ik dat de IAMA vaak een eye‑opener is: het dwingt teams om verder te kijken dan techniek en privacy alleen.

AIIA: wanneer je met AI-systemen werkt

Met de komst van de Europese AI verordening zie ik dat organisaties steeds vaker worstelen met de vraag: “Valt dit onder de AI Act?”

De AIIA (AI Impact Assessment) helpt die vraag te beantwoorden. Het instrument is bedoeld om te beoordelen of een AI systeem voldoet aan de eisen van de AI verordening, vooral wanneer het gaat om hoog risico AI. In projecten waar ik bij betrokken ben, wordt de AIIA steeds vaker een vast onderdeel van het ontwikkelproces.

Mijn advies is om een AIIA te doen wanneer:

- Je een AI-systeem ontwikkelt, inkoopt of inzet;

- Je moet voldoen aan de AI-verordening;

- Je risico’s wilt beoordelen die specifiek zijn voor AI, zoals modelbias, datakwaliteit en autonomie.

De AIIA kijkt dus naar de technische én juridische risico’s van AI-systemen zelf.

Hoe ze samenhangen in de praktijk

Veel organisaties merken dat ze niet één instrument nodig hebben, maar een combinatie. Zeker wanneer een AI model persoonsgegevens verwerkt én beslissingen ondersteunt, lopen de domeinen in elkaar over.

Een praktische vuistregel:

- DPIA = Privacy en persoonsgegevens

- IAMA = Mensenrechten & Algoritmes

- AIIA = AI-systemen & Europese verplichtingen

In projecten waar bijvoorbeeld een AI model persoonsgegevens verwerkt én beslissingen ondersteunt, heb je ze mogelijk alle drie nodig.

Een voorbeeld uit de praktijk

Stel je een grote overheidsinstantie voor die een nieuw digitaal systeem wil inzetten om burgers sneller te helpen bij het toekennen van toeslagen. Het idee is dat een algoritme automatisch beoordeelt of iemand recht heeft op een toeslag, hoeveel die persoon krijgt en of er signalen zijn die wijzen op mogelijke fouten of misbruik.Het systeem verzamelt daarvoor allerlei gegevens: inkomensinformatie, gezinssamenstelling, eerdere aanvragen, schulden, woonadres en zelfs patronen in eerdere aanvragen. Het model leert van historische data en maakt vervolgens voorspellingen over nieuwe aanvragen.

Al snel wordt duidelijk dat dit systeem diep ingrijp in het leven van burgers. Daarom moet de organisatie de drie verschillende toetsen uitvoeren. Een DPIA omdat er veel persoonsgegevens verwerkt worden. Een AIIA omdat het een algoritme is dat beslissingen beïnvloedt en een IAMA omdat fundamentele rechten op het spel staan.

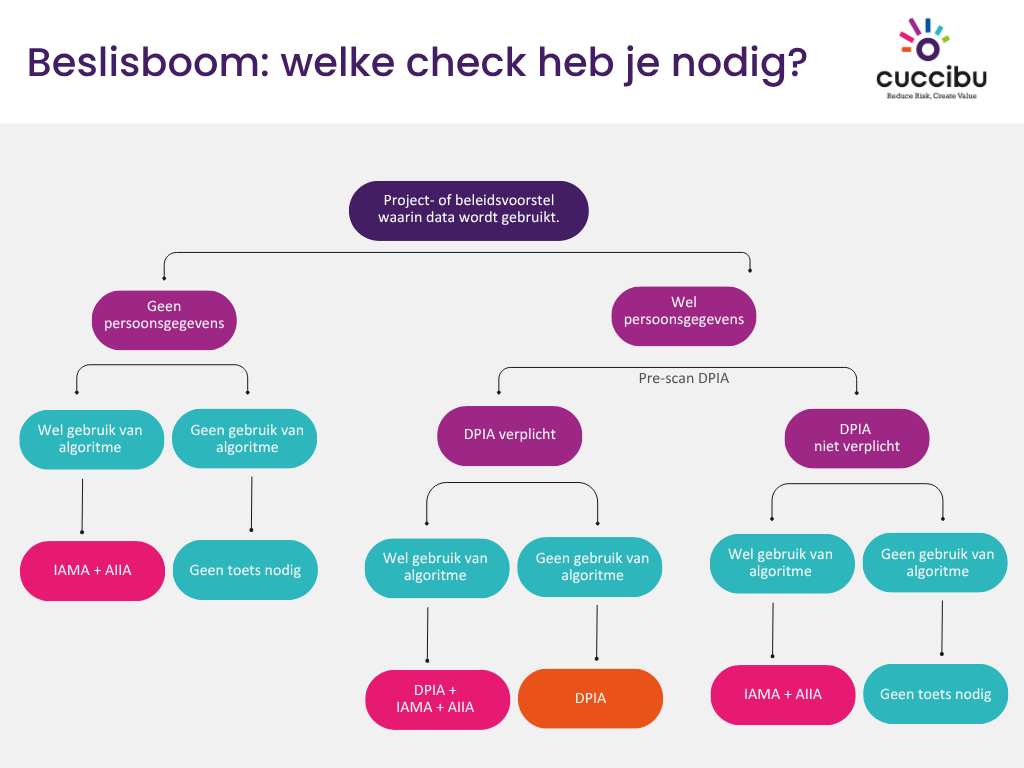

Onderstaande beslisboom helpt organisaties bepalen welke instrumenten van toepassing zijn. De essentie blijft: elke instrument dekt een ander deel van het risico.

Conclusie

De kunst is dus niet om het juiste instrument te kiezen, maar om te begrijpen welke risico’s je wilt afdekken. Zodra je dat helder hebt, volgt de keuze bijna vanzelf en wordt het inzetten van een DPIA, IAMA en AIIA geen maar een logisch onderdeel van verantwoord digitaliseren.

Bij Cuccibu helpen we organisaties dagelijks om deze toetsen uit te voeren. Of het nu gaat om het uitvoeren van een DPIA op de verwerking van persoonsgegevens in een AI-systeem of het in kaart brengen met de risico’s met een AI Risico Scan (vergelijkbaar met een AIIA). Onze consultants staan voor je klaar!

Reduce Risk, Create Value!